I grandi modelli linguistici (LLM) come ChatGPT sono destinati a sconvolgere le imprese in modo ancora più drammatico di Internet. E, come le precedenti innovazioni tecnologiche - personal computer, Internet, cloud e posta elettronica - gli LLM hanno suscitato un'ondata di preoccupazioni per la sicurezza.

È nella natura umana rispondere all'ignoto, soprattutto per quanto riguarda la sicurezza e la privacy, con una sana dose di scetticismo. Spesso la reazione immediata è quella di vietare del tutto tecnologie rivoluzionarie come l'IA generativa, fino a quando non sarà garantita la loro sicurezza. Questa è stata la reazione di numerose aziende e persino di interi Paesi. Tuttavia, la storia ci ha sempre dimostrato che queste innovazioni, se gestite correttamente, producono enormi ritorni.

Invece di vietare questi strumenti, dovremmo integrarli in modo sicuro nei nostri sistemi. Abbiamo delineato le raccomandazioni per adattarsi in modo sicuro a questa nuova ed entusiasmante tecnologia.

1. Definire una politica di utilizzo dell'LLM

La definizione di una politica di utilizzo dei modelli linguistici di grandi dimensioni è essenziale per garantire un uso responsabile e sicuro di questa tecnologia, con particolare attenzione alla sicurezza dei dati e alla privacy. La politica dovrebbe diventare la base per un uso etico e sicuro. Ecco una panoramica di ciò che tale politica può includere:

Responsabilità dell'utente:

- Uso autorizzato: Specificare chi è autorizzato a utilizzare l'LLM e per quali scopi.

- Formazione e consapevolezza: Definire l'obbligo di formazione per gli utenti sull'uso etico e sulla privacy dei dati.

- Conformità: Gli utenti devono rispettare le leggi e le normative pertinenti che regolano la privacy e la sicurezza dei dati.

- Attività vietate: Siate chiari su ciò che è consentito e ciò che non lo è, come ad esempio l'utilizzo dell'LLM per scopi illegali o la generazione di contenuti dannosi.

- Consenso e riconoscimento: Richiedere agli utenti di riconoscere e accettare la politica prima di accedere all'LLM.

Procedure di trattamento dei dati:

- Privacy dei dati: Definire il modo in cui i dati degli utenti saranno gestiti e protetti per garantire la privacy.

- Sicurezza dei dati: Dettagliare le misure di sicurezza per salvaguardare i dati da accessi non autorizzati o da violazioni.

- Conservazione e cancellazione dei dati: Specificare le linee guida per la durata della conservazione dei dati e per la loro cancellazione sicura quando non sono più necessari.

- Riservatezza: Chiarire i requisiti di riservatezza per le informazioni generate o condivise utilizzando l'LLM.

Specifiche di applicazione:

- Conseguenze delle violazioni: Delineare le potenziali conseguenze in caso di violazione della politica d'uso.

- Disciplina progressiva: Descrivere un approccio disciplinare progressivo per affrontare le violazioni delle politiche, come avvertimenti, sospensioni o interruzione dell'accesso.

- Conseguenze legali: Informare gli utenti delle potenziali azioni legali in caso di gravi violazioni della politica, in particolare quelle che riguardano le leggi sulla privacy dei dati.

Ulteriori considerazioni:

- Linee guida etiche: Incorporare linee guida etiche per l'utilizzo responsabile del LLM, comprese considerazioni sulla parzialità e sull'equità dei contenuti generati.

- Monitoraggio e verifica: Specificare le procedure per il monitoraggio e la verifica dell'utilizzo dell'LLM per garantire la conformità alla politica.

- Meccanismi di segnalazione: Fornire istruzioni chiare per la segnalazione di violazioni della politica o di incidenti di sicurezza.

La comunicazione regolare, la formazione e l'applicazione delle politiche sono fondamentali per garantire la conformità e mantenere la fiducia degli utenti e delle parti interessate.

2. Aggiungere gli LLM alla formazione obbligatoria in materia di sicurezza e privacy.

Una volta delineata la politica aziendale, aggiungete l'uso dell'LLM nei materiali di formazione obbligatori sulla sicurezza e sulla privacy. Gli utenti devono essere istruiti sui rischi potenziali e sulle strategie per ridurli. La formazione per gli LLM può riguardare:

- Le basi di come funzionano gli LLM

- Quali dati è sicuro elaborare attraverso un LLM?

- Tecniche di anonimizzazione dei dati per ridurre i rischi per la sicurezza e la privacy

- Revisione e attestazione delle linee guida della politica di LLM

3. Scegliere saggiamente i fornitori di LLM

Aziende affidabili e rispettabili come Microsoft, AWS e Google dovrebbero essere le fonti di riferimento per integrare gli LLM nella vostra infrastruttura. I fornitori di LLM legittimi offrono modelli ben sviluppati, accuratamente testati e continuamente aggiornati. Questo garantisce una qualità superiore in termini di accuratezza, comprensione della lingua e prestazioni. L'utilizzo di un fornitore affidabile riduce al minimo il rischio di errori o distorsioni nei risultati del modello linguistico.

I fornitori di LLM affermati spesso offrono opzioni di personalizzazione e supportano l'integrazione con i sistemi e le applicazioni aziendali esistenti. Ciò consente alle aziende di adattare il modello linguistico a casi d'uso e flussi di lavoro specifici.

Questi giganti del settore hanno una comprovata esperienza in fatto di misure di sicurezza rigorose e di pronta risposta alle preoccupazioni degli utenti.

4. Assicurare che le tecnologie derivate siano conformi alle politiche

I prodotti derivati alimentati da LLM devono dare priorità a solide pratiche di sicurezza e privacy per salvaguardare i dati degli utenti e garantire la fiducia nel prodotto. Le raccomandazioni includono:

- Condurre audit regolari per valutare e migliorare le misure di sicurezza, identificando e riducendo le potenziali vulnerabilità.

- Adottare le più recenti misure di sicurezza, come la crittografia, l'autenticazione a più fattori e i sistemi di rilevamento delle intrusioni.

- Implementare solidi protocolli di gestione dei dati che comprendano una raccolta dei dati ridotta al minimo, tecniche di anonimizzazione e controlli di accesso rigorosi.

- La conformità con certificazioni di sicurezza di terze parti affidabili, come ISO 27001 o SOC 2, dimostra l'impegno a soddisfare standard riconosciuti a livello internazionale.

Aderendo a queste politiche, i prodotti derivati possono tutelare la privacy degli utenti, ridurre i rischi per la sicurezza e promuovere la fiducia nelle loro operazioni.

5. Implementare le impostazioni sulla privacy per salvaguardare i dati sensibili

Le organizzazioni possono salvaguardare la privacy degli utenti e sostenere pratiche etiche di trattamento dei dati inviando LLM anonimizzati o mascherati piuttosto che informazioni di identificazione personale (PII).

Inoltre, i metadati, che comprendono le informazioni sui dati (come i timestamp, le dimensioni o i tipi di file), forniscono preziose informazioni per l'addestramento dei modelli senza esporre dati personali sensibili. Questo approccio non solo riduce i rischi associati alle violazioni dei dati e agli accessi non autorizzati, ma rafforza anche la trasparenza e la responsabilità nelle implementazioni dell'IA.

L'importante è gestire la governance e la conformità dei dati per promuovere la fiducia tra gli utenti e le parti interessate e incoraggiare nuovi livelli di produttività con l'adozione responsabile dell'IA.

6. Crittografare i dati per ridurre i rischi

La crittografia garantisce che i dati rimangano riservati e illeggibili per le parti non autorizzate. Quando si collabora con parti esterne o si utilizzano servizi basati su cloud per sfruttare gli LLM, la crittografia dei dati garantisce che essi rimangano sicuri durante la trasmissione e l'archiviazione. Ciò consente la condivisione e l'elaborazione sicura dei dati su piattaforme e ambienti diversi.

In molti settori e regioni vigono norme severe sulla protezione dei dati sensibili (ad esempio, GDPR, HIPAA). La crittografia dei dati quando si utilizzano gli LLM aiuta le aziende a soddisfare questi requisiti di conformità, salvaguardando le informazioni personali o sensibili.

7. Rivedere e aggiornare regolarmente le politiche

Le revisioni periodiche delle politiche di utilizzo del LLM aiutano a valutare l'efficacia delle misure di sicurezza esistenti e a identificare le aree da migliorare. Analizzando l'utilizzo reale e gli incidenti, le aziende possono raccogliere informazioni preziose sull'evoluzione dei rischi e adeguare le politiche di conseguenza. Questo approccio proattivo aiuta ad affrontare le minacce e le vulnerabilità emergenti prima che si trasformino in problemi significativi.

Man mano che i fornitori di LLM rilasciano aggiornamenti e patch per risolvere le vulnerabilità, le aziende devono integrare queste modifiche nelle loro politiche e procedure. In questo modo si garantisce che le implementazioni di LLM rimangano sicure e resilienti contro le minacce informatiche in evoluzione.

Un altro vantaggio delle revisioni periodiche delle politiche è la promozione di una cultura del miglioramento continuo e della responsabilità all'interno dell'organizzazione. Coinvolgere le parti interessate e sollecitare il feedback degli utenti può contribuire a migliorare la consapevolezza e l'efficacia. Questo approccio collaborativo incoraggia una responsabilità condivisa per la sicurezza e la privacy in tutta l'azienda, rafforzando le pratiche complessive di gestione del rischio.

Riflessioni finali

Un piano strategico di sicurezza per l'IA generativa può aiutare le aziende a mitigare i rischi di sicurezza associati all'adozione di LLM e a coltivare una cultura di fiducia e responsabilità nell'implementazione dell'IA. L'adozione di questi principi pone le basi per sfruttare il pieno potenziale degli LLM salvaguardando l'integrità e la privacy dei dati degli utenti, aprendo così la strada a un futuro sicuro e trasformativo delle tecnologie di IA generativa.

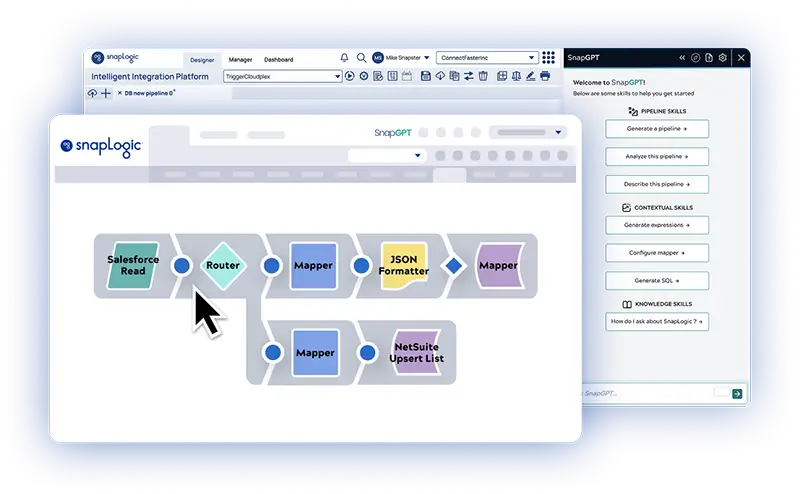

Per saperne di più sugli standard di sicurezza e conformità di SnapLogic, per aiutare le aziende a integrare dati e IA e a innovare con fiducia.